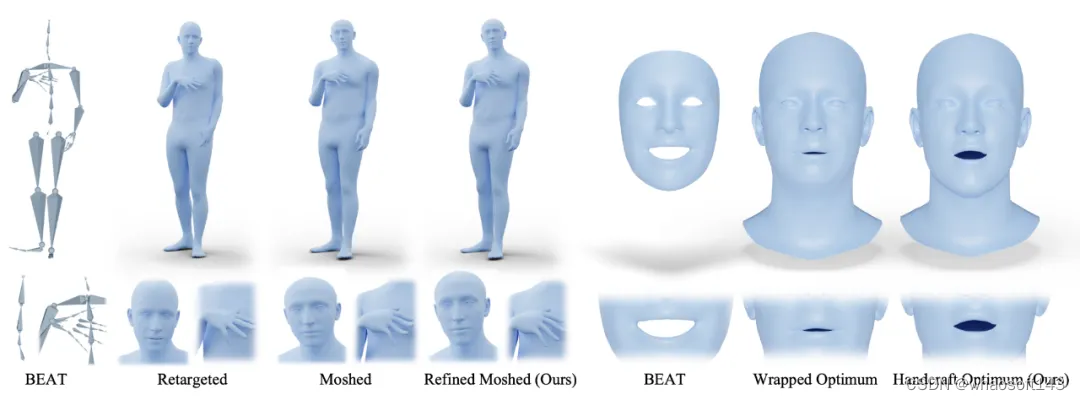

主要功能• 音频驱动的全身动作生成:能够根据输入的音频信号生成与之同步的全身动作。

• 面部表情生成:生成逼真的面部表情和口型,与语音内容相匹配。

• 肢体动作生成:生成包括手臂、腿部和手部在内的自然肢体动作。

• 动作掩码重建:使用动作掩码来重建和改善动作生成的准确性。

• 自适应特征融合:结合音频的节奏和内容,自适应地生成具有语义关联的动作。

• 预训练的VQ-Decoder:使用预训练的向量量化变分自编码器(VQ-Decoder)来解码面部和局部肢体运动。

• 面部表情生成:生成逼真的面部表情和口型,与语音内容相匹配。

• 肢体动作生成:生成包括手臂、腿部和手部在内的自然肢体动作。

• 动作掩码重建:使用动作掩码来重建和改善动作生成的准确性。

• 自适应特征融合:结合音频的节奏和内容,自适应地生成具有语义关联的动作。

• 预训练的VQ-Decoder:使用预训练的向量量化变分自编码器(VQ-Decoder)来解码面部和局部肢体运动。

应用场景• 虚拟主播:在新闻播报或在线教育中提供生动的虚拟主持人。

• 游戏开发:为游戏角色添加更丰富、真实的互动性。

• 电影制作:辅助生成逼真的CGI效果。

• 沟通辅助工具:帮助有语言障碍的人以虚拟形象表达情感。

• VR和AR:在虚拟现实和增强现实环境中提供更加沉浸式的体验。

• 数字人技术:在虚拟环境中创建具有高度表现力和协调性的数字人。

• 游戏开发:为游戏角色添加更丰富、真实的互动性。

• 电影制作:辅助生成逼真的CGI效果。

• 沟通辅助工具:帮助有语言障碍的人以虚拟形象表达情感。

• VR和AR:在虚拟现实和增强现实环境中提供更加沉浸式的体验。

• 数字人技术:在虚拟环境中创建具有高度表现力和协调性的数字人。